打破“快与聪明”的二元对立

2025 年 12 月 17 日,谷歌正式推出了其最新的轻量级模型——Gemini 3 Flash。

长期以来,我们在选择 AI 模型时似乎总面临一个“不可能三角”:想要聪明(如 Pro/Ultra/o1 类模型),就得忍受高昂的推理成本和缓慢的响应速度;想要快和便宜(如此前的 Flash 系列),往往就得牺牲逻辑推理能力,接受一个只能处理简单任务的“直觉流”助手。

但这一次,Gemini 3 Flash 似乎打破了这个定律。

官方将其定义为“为速度而生的前沿智能”。它不仅继承了 Flash 系列一贯的极速响应和低成本优势(对普通用户甚至免费),更具颠覆性的是,谷歌首次将高阶模型的“思考(Thinking)”能力下放给了轻量级模型。这意味着,在 AI 的世界里,“快”不再等同于“浅薄”。

Gemini 3 flash:又快又聪明

Gemini 3 Flash 之所以引发关注,并不单单是因为它的速度,而是它在保持轻量级特性的同时,补齐了以往小模型最欠缺的几块短板:

“思考”能力的下放 (Thinking Process)

这是本次更新最大的亮点。Gemini 3 Flash 引入了以往仅限于高阶模型的 Thinking Process(思考过程)。这意味着 Flash 不再是单纯依靠概率预测下一个字的“直觉流”选手,而是学会了“先想后说”。

在衡量编程能力的权威测试 SWE-bench Verified 中,Gemini 3 Flash 取得了 78% 的高分。这个成绩不仅显著超越了上一代的中坚力量 Gemini 2.5 Pro,更在代码生成与逻辑推导上,展现出了比肩许多大模型的实力。

视觉与多模态的“显微镜”

依托于 100 万 Token 的超长上下文窗口,Gemini 3 Flash 在处理多模态信息时表现出了惊人的细腻度。

在多项第三方测评中,它展现了“显微镜”级的 OCR 能力:无论是识别模糊的小票、强反光下的文字,还是精准清点图片中密集的物体(例如从一群火烈鸟中找出唯一的白色那只),它都能轻松应对。对于需要处理杂乱非结构化数据的用户来说,这种能力至关重要。

速度与成本的平衡

在智力大幅跃升的同时,它依然保持了 Flash 系列标志性的低延迟与高吞吐。目前,谷歌已将其设置为 Google 搜索(AI Overviews)和 Gemini App 的默认模型。对于普通用户和开发者而言,这意味着我们可以在几乎无感知的延迟下,免费或以极低的成本调用一个具备深度推理能力的 AI 大脑。

💡开发者特别福利:Gemini CLI

谷歌这次还专门为开发者推出了命令行工具(Gemini CLI)。如果你习惯在终端(Terminal)工作,现在可以直接用命令调用 Gemini 3 Flash 进行代码审查或生成提交信息,无需离开键盘,效率拉满。

- 详情可见Google Developers Blog:Gemini 3 Flash is now available in Gemini CLI

Gemini3 三个版本比较

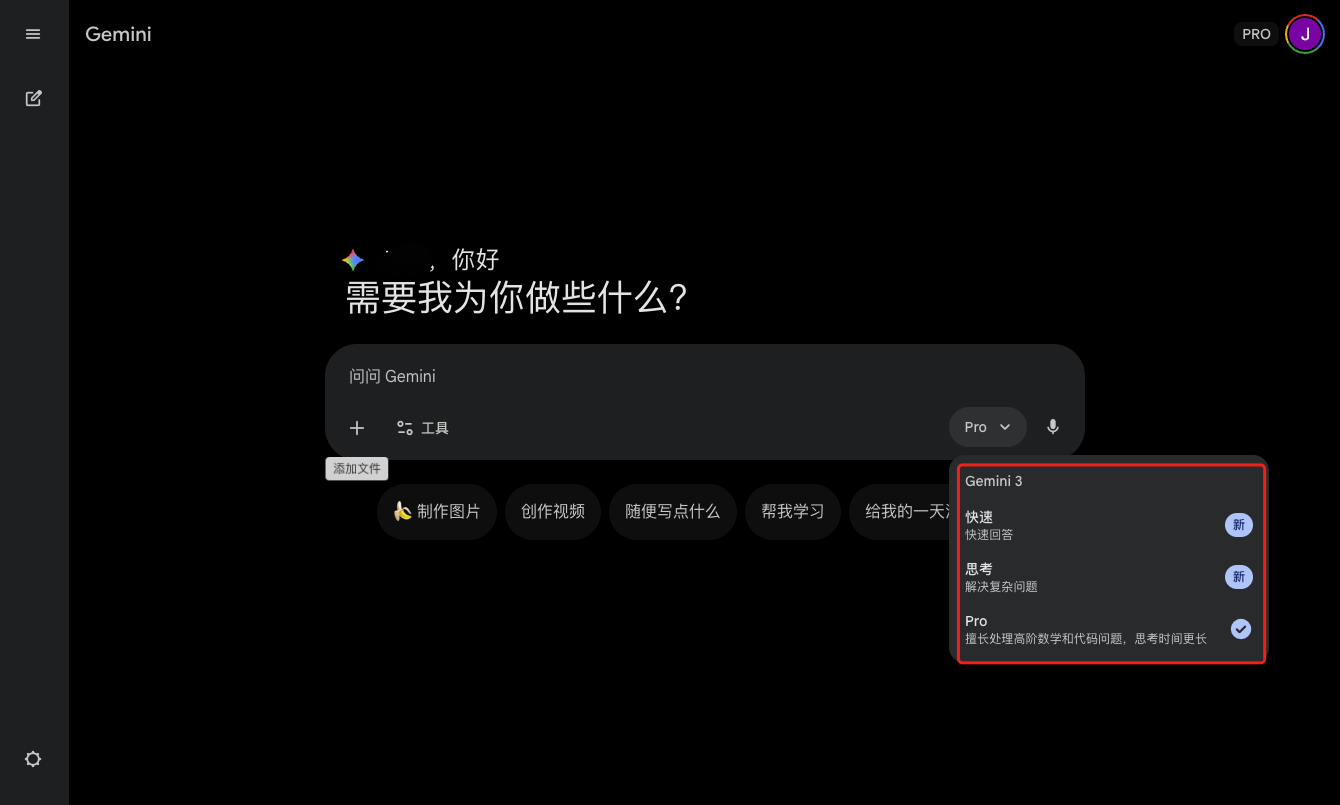

打开 Gemini 的对话框,很多朋友会看到“快速”、“思考”、“专业”三个选项,难免会产生困惑:到底哪个才是刚刚发布的 Gemini 3 Flash?

答案是:前两个都是。

谷歌这次采取了一种非常灵活的策略:将同一个 Gemini 3 Flash 模型拆分成了两种“用法”。界面上的差异,本质上是是否让模型开启“深思熟虑”模式。

为了方便大家理解,我整理了下面这张对比表:

| 界面选项 | 背后模型 | 核心特点 | 它是谁?(比喻) |

|---|---|---|---|

| 快速 (Fast) | Gemini 3 Flash(标准版) | 极速响应。不展示思考过程,依靠直觉瞬间给出回答。 | “凭直觉秒回的天才实习生”(动作极快,处理杂活一把好手) |

| 思考 (Thinking) | Gemini 3 Flash(Thinking 版) | 逻辑推理。会展示思考步骤(Thinking Process),先打草稿再回答。这是本次升级的精华。 | “打草稿深思熟虑的天才实习生”(即使是复杂问题,也能理清逻辑) |

| 专业 (Pro) | Gemini 3 Pro | 深度攻坚。处理最复杂的系统架构、创意写作或高难度推理任务。 | “该领域的资深老教授”(只有最难的问题才去请教他) |

结论很简单:不要纠结于“哪个是新的”,Flash 的标准版和 Thinking 版都是 12 月 17 日发布的新品。

- 如果你追求速度,选“快速”;

- 如果你追求逻辑准确性(比如写代码、算数),选“思考”。

对于绝大多数日常场景,Gemini 3 Flash (Thinking 版) 提供了以前 Pro 模型才有的智商,却保持了 Flash 级别的低成本(甚至免费),是目前的性价比之王。

实战指南:不同场景下如何“人尽其才”?

对于 Indie Maker 而言,效率的核心在于“把对的模型用在对的地方”。基于 Gemini 3 Flash 的特性,我总结了以下分级使用策略:

场景一:Gemini 3 Flash (标准版)

核心心法:唯快不破

当你不需要模型进行深度推理,只追求毫秒级的响应速度时,标准版是最佳选择。

- 外语阅读辅助:快速翻译长篇技术文档或新闻。

- 日常琐事处理:润色邮件、改写简单的社交媒体文案。

- 事实性查询:比如“Excel 的 VLOOKUP 公式怎么写”或“Linux 修改权限的命令是什么”,它能瞬间给出标准答案。

💡注意:谷歌搜索中,概览overview 模式和AI model模式,默认都是使用Gemini 3 Flash (标准版)。

场景二:Gemini 3 Flash (Thinking 版) —— ⭐ 推荐默认常驻

核心心法:逻辑与成本的完美平衡点

这是目前性价比最高的“主力模式”。当你需要逻辑准确,但又不想消耗昂贵的 Pro 额度时,请无脑选它。

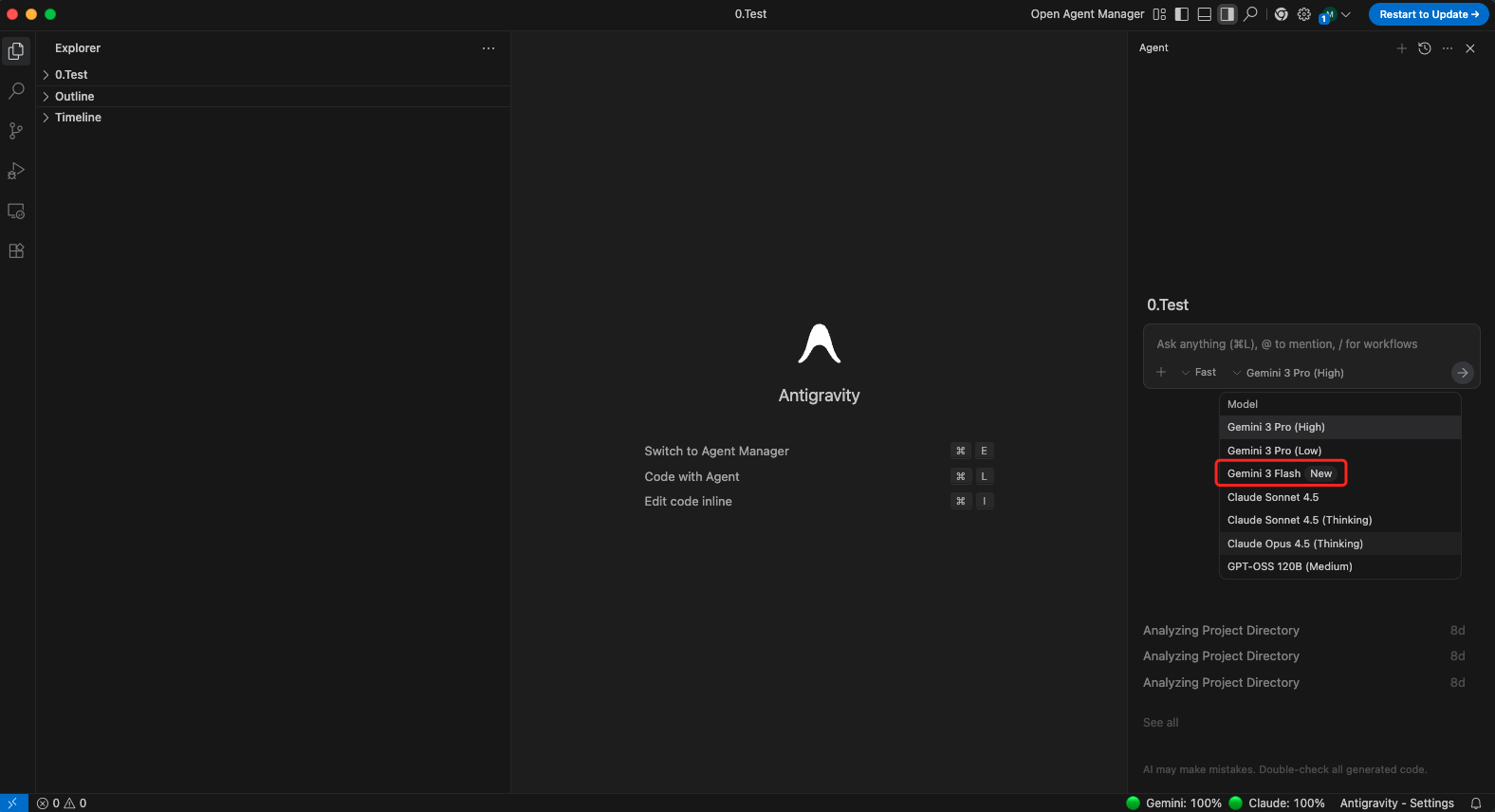

辅助编程 (Google antigravity最佳拍档):强烈建议在 antigravity 的 Plan 模式中调用它。实测显示,它能胜任生成网页原型、复杂的交互代码(如前文提到的兵马俑跳舞动画、3D 场景构建)。它会先拆解需求再写代码,成功率极高。

长文档/多模态分析:丢给它一个 30 分钟的技术视频或几十页的 PDF 财报,让它总结核心要点。得益于 100 万 Token 窗口和推理能力,它的总结不再是流水账。

逻辑推导:处理数学题或需要分步骤拆解的逻辑谜题。

场景三:Gemini 3 Pro

核心心法:最后的“重武器”

当 Flash (Thinking) 处理失败、逻辑打结或者出现幻觉时,再请出这位“老教授”。

- 顶层架构设计:设计复杂的 SaaS 系统数据库结构或微服务架构。

- 深度创意写作:编写长篇小说、复杂的剧本,需要极强的一致性和文笔。

- 学术级推理:处理极其生僻或需要极高精度的科研问题。

写在最后:AI 普惠时代的超级个体红利

Gemini 3 Flash 的出现,标志着“深度思考”不再是昂贵模型的特权。

对于超级个体(Indie Maker)来说,这意味着我们现在的试错成本极低——你可以免费拥有一个懂逻辑、会写代码的顶级大脑。

最后,条件允许的话,现在就打开你的 Gemini,把模型切换到 Gemini 3 flash Thinking(思考) 模式试一试。

参考来源

- 官方发布公告:Gemini 3 Flash: frontier intelligence built for speed

- Google The Keyword Blog (适合大众阅读)

- 强调“Gemini 3 Flash 现已对所有人免费”、“速度极快”、“默认模型”。

- 开发者 CLI 指南:Gemini 3 Flash is now available in Gemini CLI

- Google Developers Blog (适合硬核玩家)

- 技术参数文档:Generative AI on Vertex AI

- Vertex AI Documentation (适合企业选型)

- Google Cloud Vertex AI Docs